Скормил нейросети 40 статей ПИК с Хабра: RAG-бот на GigaChat для BIM без опыта в разработке

Предыстория: архитектура, BIM и попытки автоматизации

Меня зовут Владислав Пономарев, я архитектор, проектирую дома. Ещё в магистратуре, 10 лет назад я занимался BIM-внедрением в проектной организации в Сочи. Это были Revit, Civil 3D и другие инструменты. Делал это в рамках своей темы магистерской работы. Потом переключился на архитектуру в частном домостроительстве, где больше изучал практические вопросы проектирования и философию архитектуры, ее эстетические качества. Но любовь к более сложному BIM осталась. С энтузиазмом продвигал тему BIM, когда до массового внедрения в РФ было еще далеко.

Прошли годы. Многие вопросы, которые были актуальны тогда, еще остались в повестке отрасли. Специалисты до сих пор часто работают по старинке. А ведь теперь пришёл ещё и AI, который ложится только на автоматизированные процессы. Нет BIM – нет данных. Нет данных – нейронка не поможет. При этом автоматизировать стройку – задача очень сложная. Слишком много вопросов, которые пока трудно поддаются оптимизации.

Мои попытки в код

В 2015-2017 годах я автоматизировал проектные задачи для себя в Grasshopper (плагин визуального программирования для Rhino). Несколько раз садился учить Python, но моя работа – это всё-таки архитектура, не программирование. Отвлекался и так не выучил ни один язык.

В 2025, год назад, попробовал cгенерировать код через ChatGPT. В результате код почти не запускался, каждый раз вылезали ошибки. В общем, о вайб-кодинге я тогда забыл. А в 2026 появился Claude 4.6 Opus. Прочитал в заголовках, что это прорыв. Попробовал, и действительно: первые прототипы заработали, почти с первого раза. Если появлялись ошибки – дорабатывал в диалоге с Клодом. Встал вопрос: а что именно можно сделать?

Что там у гигантов?

Идеи для своих проектов были – автоматизация нужна и архитекторам в частном секторе. Но стало интересно: а что происходит у крупных строительных компаний? У того же ПИК? Нашёл на Хабре статью Артура Ишмаева про эксперименты ПИК с нейросетями.

Прочитал, получился довольно интересный и познавательный материал. Увидел, что в блоге ПИК 40 статей на тему автоматизации. И понял, что сейчас не смогу осилить все, но хотелось разобраться чуть детальнее. Да и от глубокой экспертизы в BIM я отошёл лет 7-8 назад. Как раз, когда крупные компании начали массовое внедрение, а я занимался этой темой ещё до всплеска интереса.

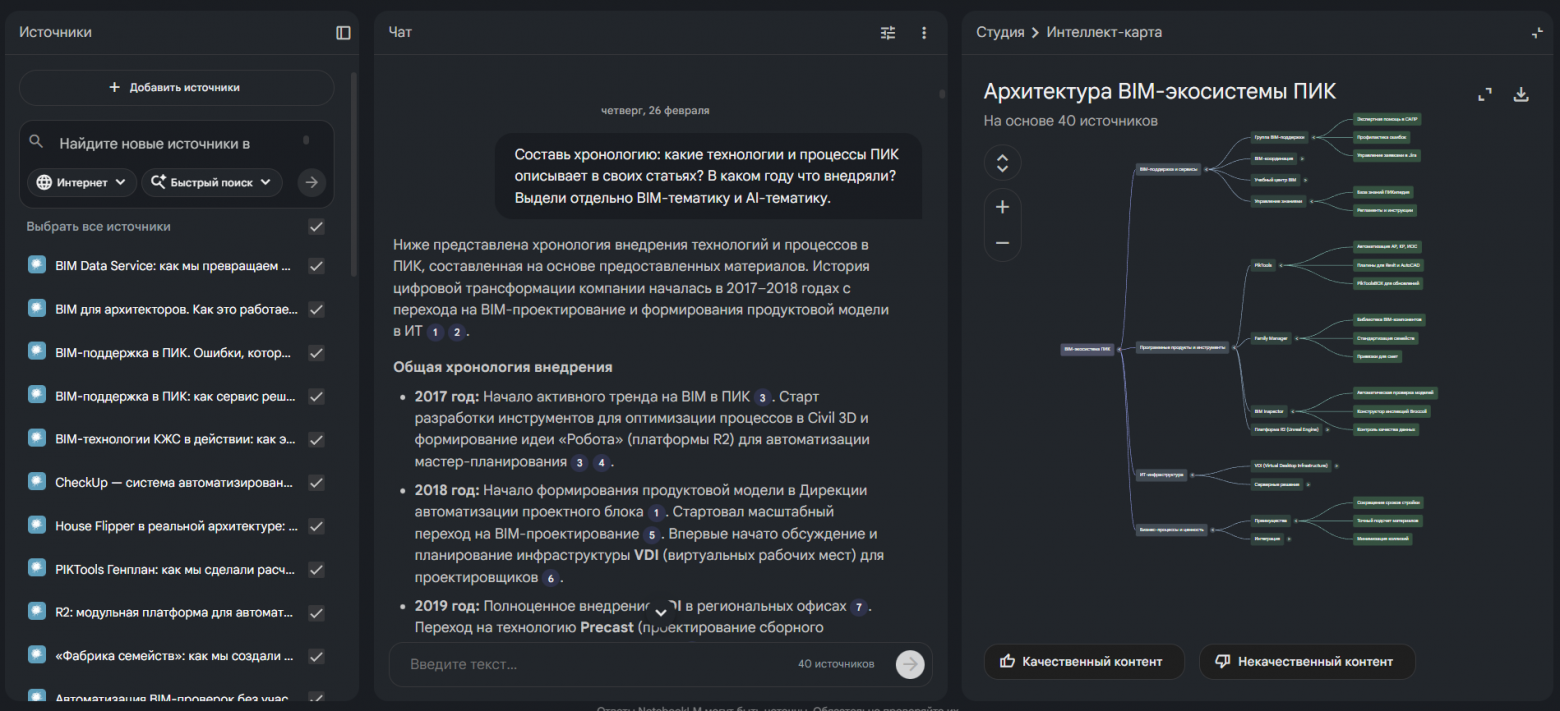

40 статей читать довольно долго. Вспомнил про NotebookLM от Google, куда можно загрузить много источников и получить качественную выжимку. Закинул все 40 статей в источники.

И тут появилась идея: а что если найти реальные проблемы, требующие решения, на основе этих статей? А дальше сделать минимально рабочий продукт (MVP).

От идеи к гипотезе: NotebookLM + Claude

Попросил Claude сформулировать 4 вопроса для анализа статей. Задал их в чат NotebookLM и получил выжимку, инсайты. На выходе – 3 самые сильные гипотезы. Отдал их Claude. В скрытом блоке более подробно о конкретных запросах к Notebook LM и 3 гипотезы для прототипирования на выходе:

Скрытый текстЗапрос №1. Составь хронологию: какие технологии и процессы ПИК описывает в своих статьях? В каком году что внедряли? Выдели отдельно BIM-тематику и AI-тематику.

Запрос №2. На основе всех загруженных статей: какие процессы ПИК уже автоматизировал, а какие описывает как ручные или "в планах"? Где видны узкие места и незакрытые задачи?

Запрос №3. Проанализируй статьи ПИК про AI/ИИ. Оцени уровень: это исследовательские эксперименты, пилотные проекты или промышленное внедрение? Какие конкретные результаты они приводят с метриками?

Запрос №4. На основе анализа: назови 3 области, где ПИК мог бы применить AI уже сейчас, исходя из тех процессов, которые они описывают в своих статьях о BIM и автоматизации. Объясни почему.

Три гипотезы для прототипов

1. Предсказание немоделируемых объемов для смет (BDS + ML)

В статьях упоминается, что система BIM Data Service (BDS) успешно извлекает объемы из моделей, но самым сложным этапом остается автоматическое добавление немоделируемых объемов (расходных материалов, метизов, грунтовки).

-

Почему это возможно сейчас: ПИК уже накопил огромную базу структурированных данных (PostgreSQL/MongoDB) о компонентах (23 000+ семейств) и результатах реальных закупок.

-

Применение AI: Использование алгоритмов машинного обучения (ML) для анализа исторических данных смет и моделей позволит автоматически прогнозировать расход материалов, которые физически не отрисовываются в Revit, на основе типа конструкций и их параметров.

2. Интеллектуальный помощник BIM-поддержки (LLM + База знаний)

ПИК располагает мощной системой управления знаниями — «ПИКипедией» (на базе Confluence) и огромным архивом заявок в Jira (около 1800 в месяц), где фиксируются нетиповые ошибки и их решения.

-

Почему это возможно сейчас: Координаторы уже используют ИИ-поиск («Алису») для поиска решений на внешних форумах, что доказывает востребованность инструмента.

-

Применение AI: Внедрение большой языковой модели (LLM), обученной на внутренних инструкциях и закрытых тикетах Jira, позволит создать умного чат-бота для проектировщиков. Это поможет мгновенно выдавать решения по специфическим ошибкам ПИК, не дожидаясь ответа координатора по SLA, которое может составлять до 9-40 часов.

3. Автоматическая группировка и приоритизация коллизий (CheckUp + AI)

Система CheckUp автоматизировала поиск тысяч геометрических пересечений, но их анализ и группировка перед выдачей отчета проектировщику всё еще выполняются координаторами вручную и отнимают много времени.

-

Почему это возможно сейчас: В планах развития CheckUp уже заложено «автогруппирование», а компания имеет четкие матрицы коллизий и стандарты.

-

Применение AI: ИИ-модели классификации могут анализировать найденные пересечения и автоматически отделять критические ошибки (например, труба сквозь балку) от допустимых или ложных срабатываний. Это позволит координаторам не просматривать каждый конфликт вручную, а сразу отправлять сгруппированные отчеты в работу, что сократит цикл проверки с часов до минут.

Почитал, подумал. Первая гипотеза показалась интересной, но для нее нужны данные. Третью гипотезу тоже было бы нужно тестировать на выдуманных или сгенерированных данных.

Попросил Клода выделить ту идею, которую реально можно реализовать за один вечер и получить рабочий прототип с видимой пользой. Выбор пал на RAG-ассистент — чат-бот, который отвечает на вопросы по BIM-статьям ПИК, не придумывая, а опираясь только на тексты и с показом источников.

Вечер разработки: от нуля до рабочего бота

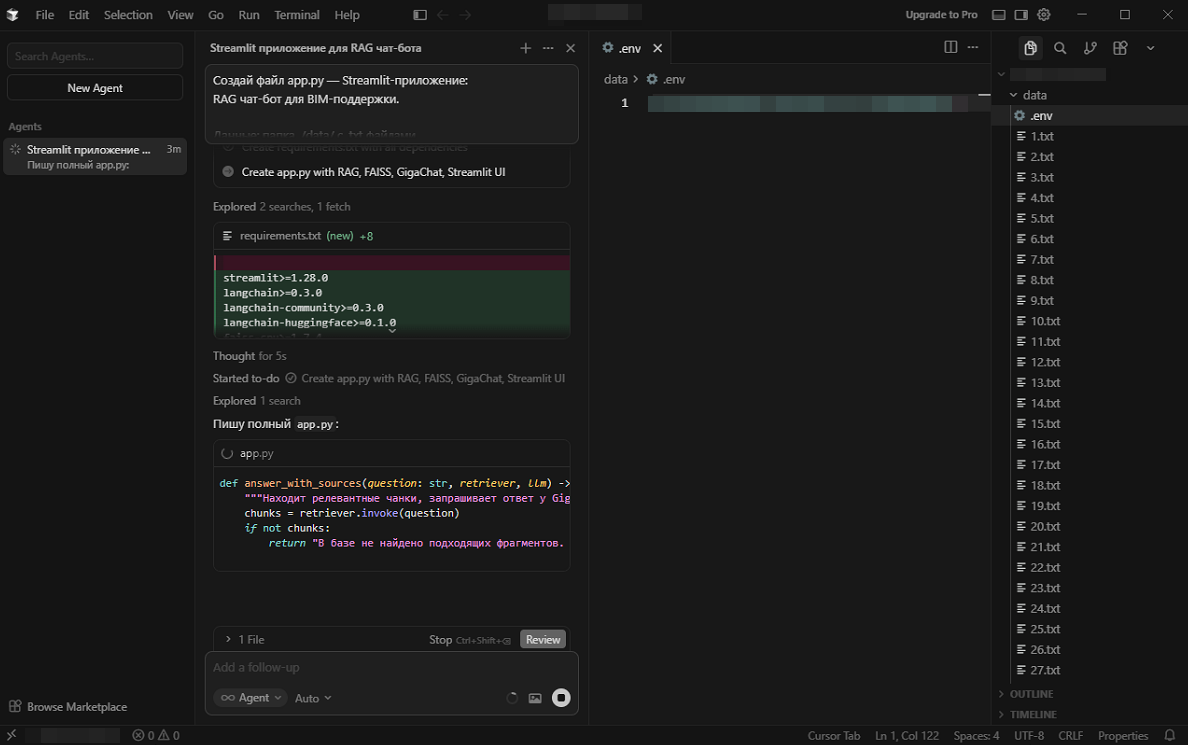

До этого момента у меня не стоял ни Cursor, ни нужные библиотеки, был установлен только Питон. Claude выдал пошаговую инструкцию. Я начал выполнять.

Шаг 1 – GigaChat API

Получил токен от GigaChat (Сбер). Решил: надо пробовать по возможности на отечественных решениях. Правда, Embeddings в GigaChat бесплатно не предоставляют. Попросил Claude заменить на бесплатную альтернативу – он предложил intfloat/multilingual-e5-large. Мультиязычная модель для векторного поиска, работает локально, бесплатно.

Шаг 2 – Cursor

Установил Cursor (IDE на базе VS Code с встроенным AI-помощником). Скинул промпт от Claude в Cursor. Появились ошибки, перекинул обратно в Claude, получил исправления. Снова в Cursor. И так до результата.

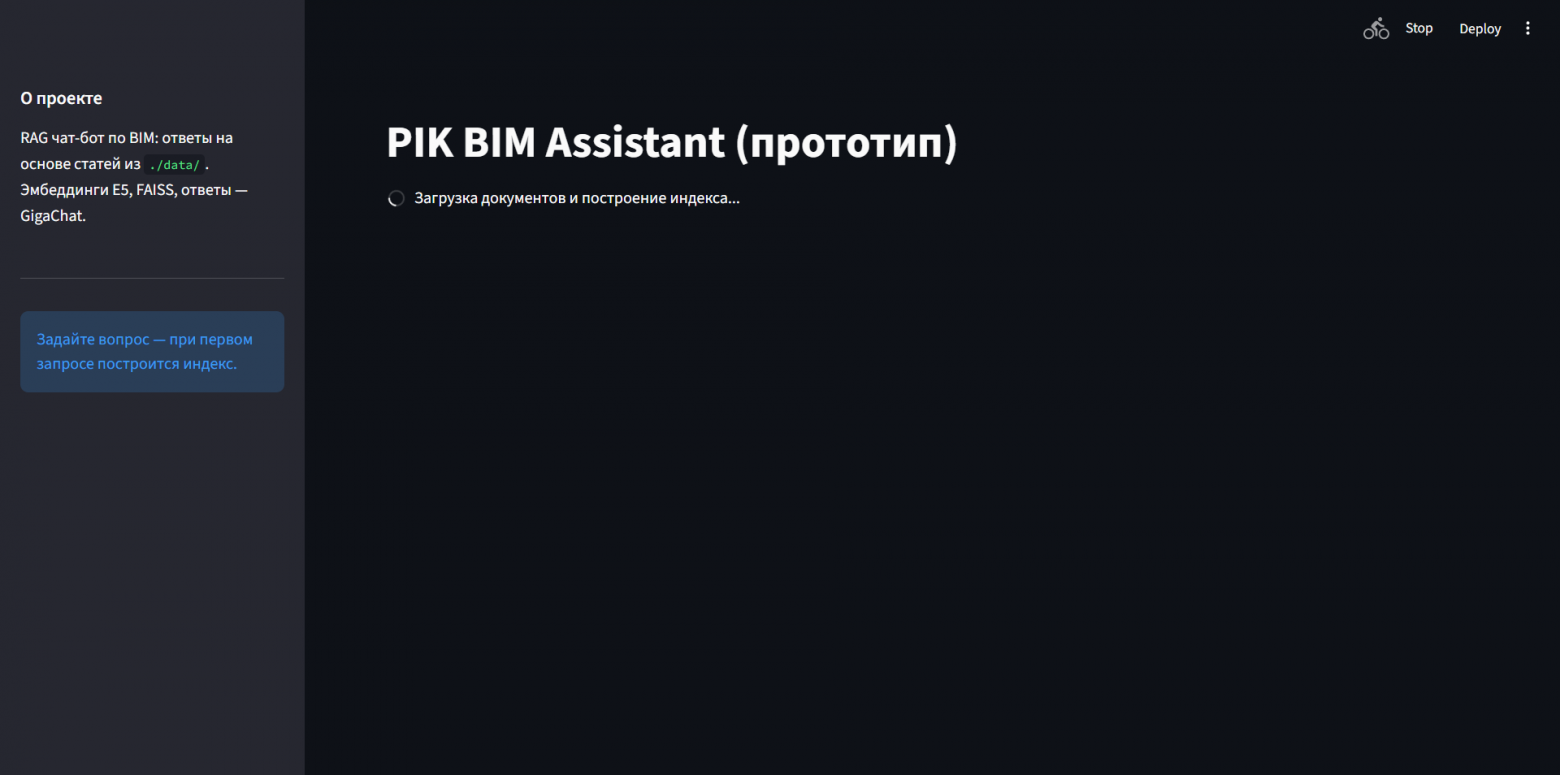

Шаг 3 — Запуск

streamlit run app.py

Как это работает

Схема следующая:

Вопрос пользователя ↓ Векторизация вопроса (E5 embeddings) ↓ Поиск 5 ближайших фрагментов в FAISS ↓ Фрагменты + вопрос → GigaChat ↓ Ответ с указанием источников

Стек

|

Компонент |

Технология |

|---|---|

|

LLM |

GigaChat (Сбер) |

|

Embeddings |

intfloat/multilingual-e5-large |

|

Vector Store |

FAISS |

|

Framework |

LangChain |

|

UI |

Streamlit |

|

IDE |

Cursor |

|

Анализ источников |

NotebookLM (Google) |

Клод выдал чуть более детально описание решений.

Весь проект – один файл app.py на ~150 строк.

E5 с префиксами для асимметричного поиска:

class E5Embeddings(HuggingFaceEmbeddings): def embed_documents(self, texts): return super().embed_documents(["passage: " + t for t in texts]) def embed_query(self, text): return super().embed_query("query: " + text)

E5 – модель, которая различает документы и запросы. Документам добавляется префикс passage:, вопросам – query:. Это даёт лучшее качество поиска по сравнению с обычными эмбеддингами.

Чанкинг – нарезка статей на фрагменты:

splitter = RecursiveCharacterTextSplitter( chunk_size=2000, chunk_overlap=400, )

Каждая статья разбивается на куски ~2000 символов с перекрытием 400. Перекрытие нужно, чтобы не терять смысл на границах фрагментов.

Системный промпт – защита от галлюцинаций:

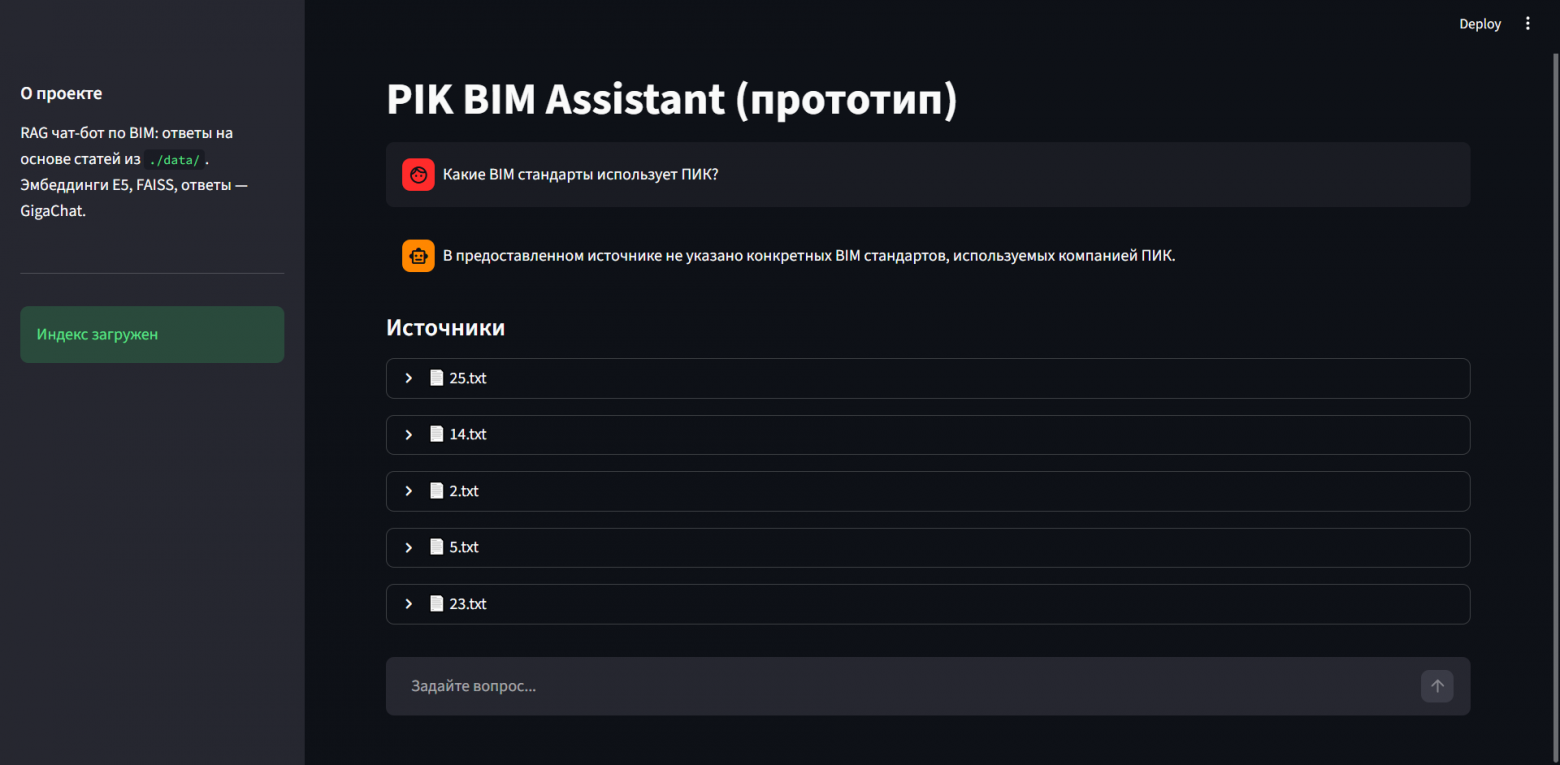

SYSTEM_PROMPT = ( "Отвечай только на основе предоставленного контекста. " "Если ответа нет в контексте — скажи, что в источниках не найдено." )

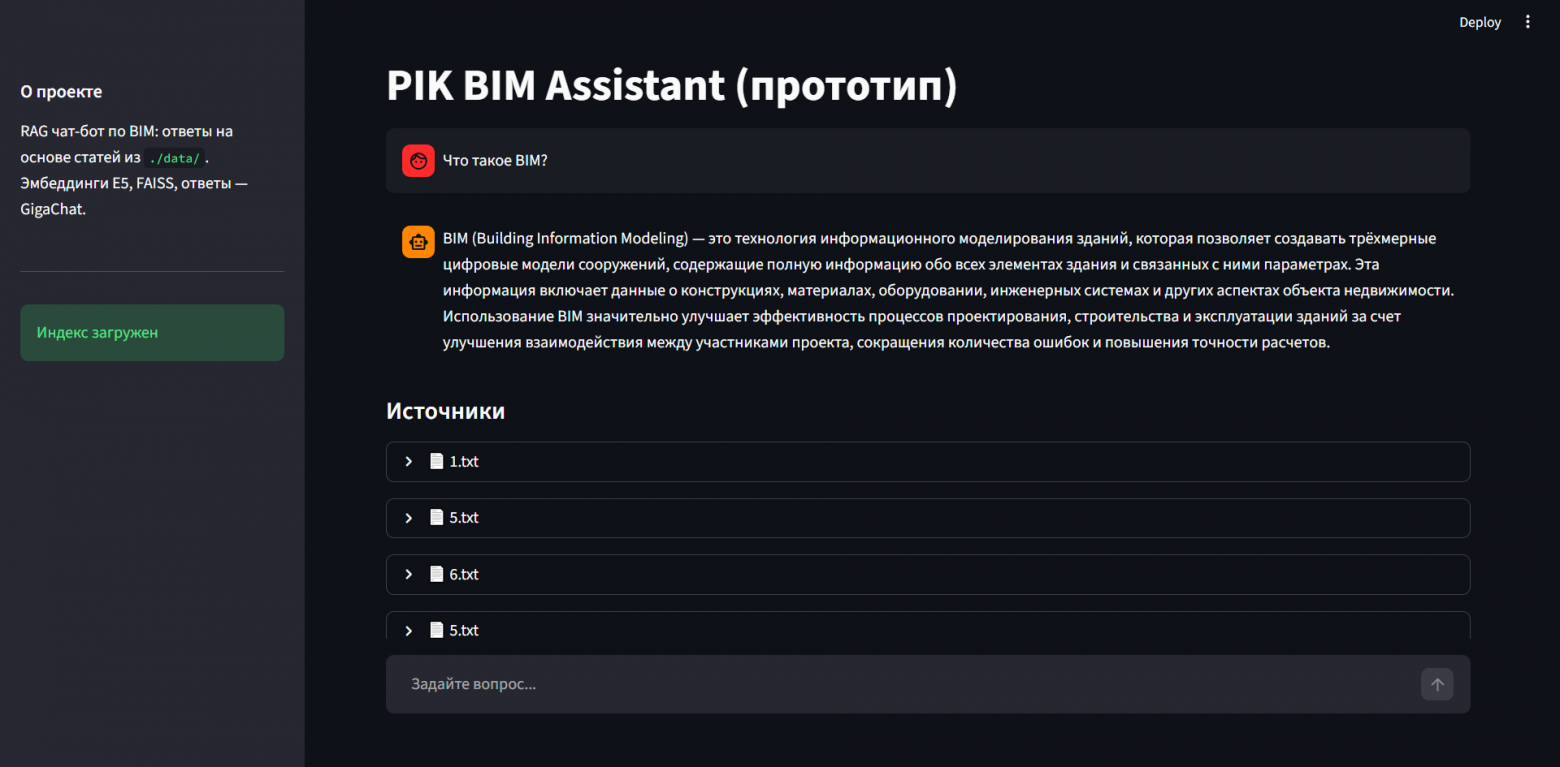

Бот не придумывает. Если в статьях нет ответа – честно говорит об этом.

Тестирование: 5 вопросов к боту

«Что такое BIM?»

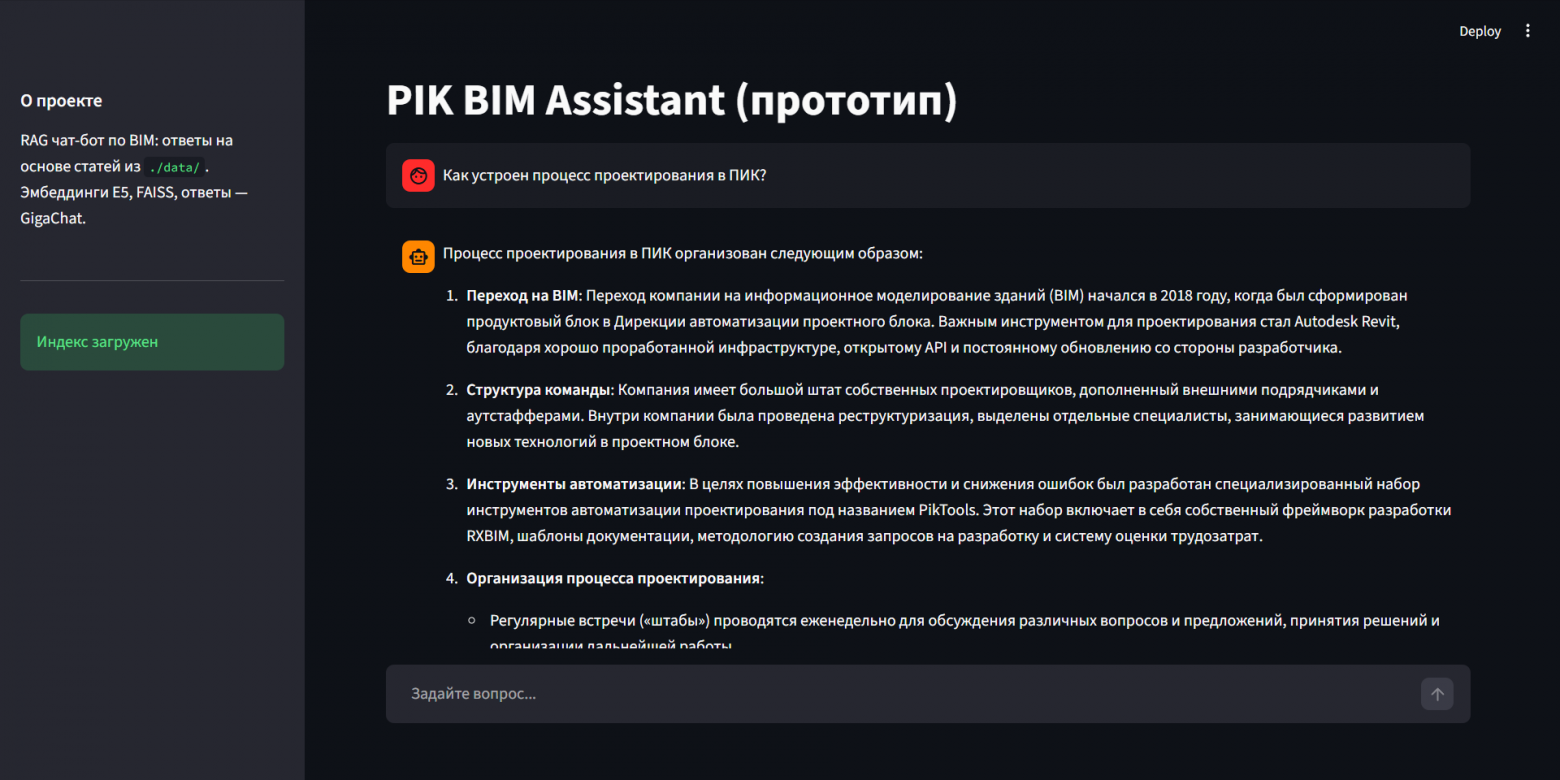

«Как устроен процесс проектирования в ПИК?»

«Какие BIM стандарты использует ПИК?»

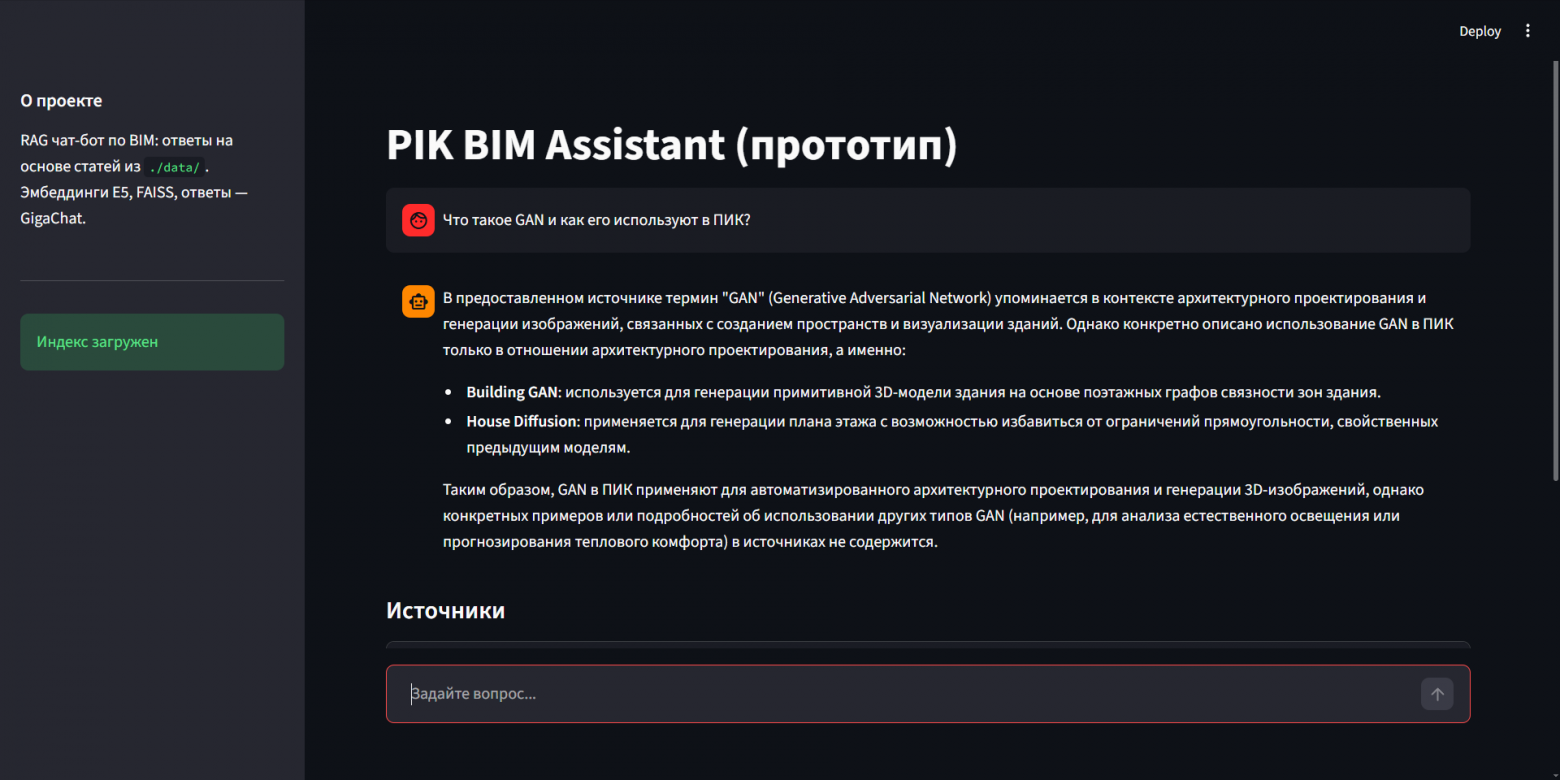

«Что такое GAN и как его используют в ПИК?»

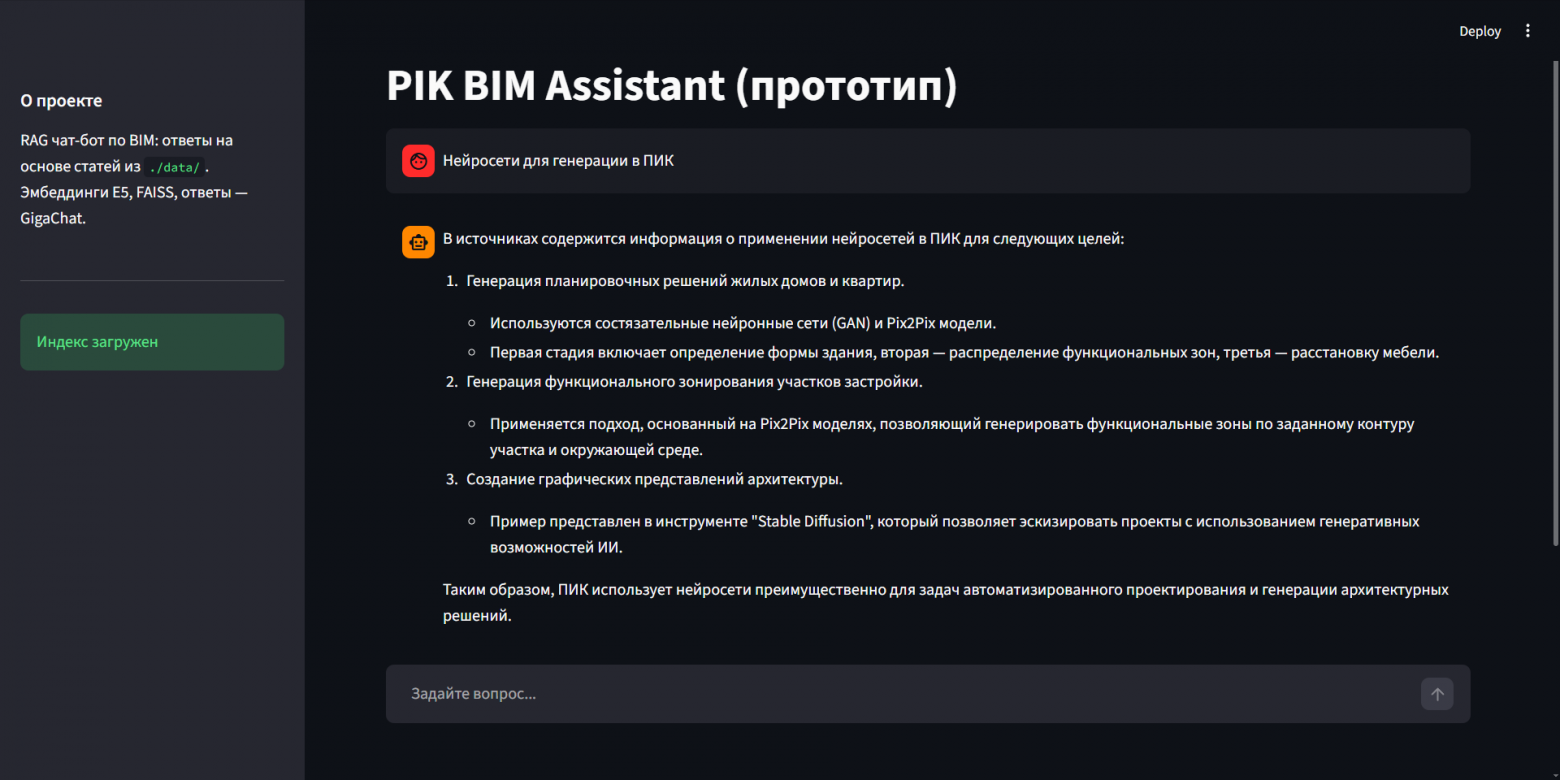

«Нейросети для генерации в ПИК»

Стоимость

Разработка: 0 ₽ (кроме рабочего времени и доступа к языковым моделям)

-

Cursor – бесплатный тариф

-

GigaChat – бесплатные токены при регистрации

-

FAISS, LangChain, Streamlit – open source

-

E5 embeddings — бесплатно, работает локально

Эксплуатация:

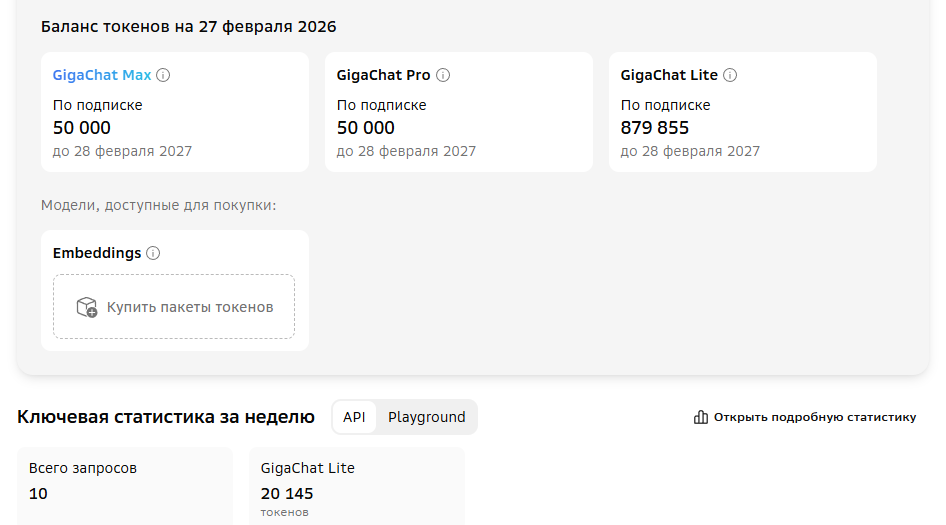

10 вопросов к боту потратили минимум токенов GigaChat:

Что это значит для отрасли

Этот прототип – не продакшн-решение. Но он показывает принцип.

В реальном применении вместо 40 статей с Хабра может быть внутренняя база знаний компании: стандарты, регламенты, проектная документация, BIM-инструкции. RAG-ассистент мог бы отвечать на вопросы сотрудников, искать информацию по тысячам документов, ускорять обучение и работу новых специалистов.

Ограничения прототипа

-

Отвечает только по загруженным статьям

-

Нет истории диалога – каждый вопрос независимый

-

Качество зависит от формулировки вопроса

-

Векторный поиск может пропустить релевантный фрагмент, если вопрос сформулирован сильно иначе, чем текст статьи

Что можно добавить:

-

Гибридный поиск (FAISS + BM25)

-

Reranking результатов

-

Память диалога

-

Автоматический парсинг статей

-

Деплой на Streamlit Cloud

Есть ли подобное в ПИК?

Возможно, в ПИК уже существует подобный AI-ассистент или что-то более продвинутое. Крупные компании естественно и правильно не рассказывают обо всех своих внутренних наработках – на Хабре публикуется лишь часть того, что происходит внутри.

По относительно недавно опубликованным статьям (декабрь 2025) такого решения не описано – поиск по-прежнему идёт через внутреннюю вики, форумы и Алису. Но это публичная информация, она может быть неполной. В любом случае, гипотеза проверена: RAG-ассистент по базе знаний строительной компании работает. Даже в минимальной конфигурации, даже на публичных статьях, даже собранный за один вечер человеком без опыта в разработке. Можно представить, что может сделать команда разработчиков с доступом к полной внутренней базе знаний.

Выводы

AI не заменяет программиста. Одно дело – собрать небольшое приложение за вечер. Другое – поддерживать масштабный сервис с ответственностью за результат.

То же самое и в архитектуре. Нейросети затронули многие области, но и программирование, и архитектуру трансформируют очень сильно. Раньше клиенты приносили вырезки из журналов, потом – картинки из Google, теперь – рендеры из Midjourney, Алисы или Nano Banana. Инструменты меняются, но суть профессии остаётся: понять задачу, найти решение и довести до реализации.

Прототип – это способ проверить идею. За один вечер, бесплатно и без опыта в разработке. Если идея рабочая – можно развивать. BIM + AI – это неизбежно. Вопрос не «будет ли», а «когда» и «кто внедрит первым».

Репозиторий

Код выложен на GitHub для тестирования: github.com/vponomarev-tech/pik-bim-assistant-prototype

Статьи в репозиторий не попали. Нужно положить свои .txt файлы в папку ./data/. Можно использовать любую текстовую базу знаний. Также нужен токен GigaChat в файле .env — инструкция в README.

P.S. Про честность

Эту статью как и код мне помогала делать нейросеть. Многие технические детали остаются для меня пока непонятными.

Но в этом и суть: такой прототип даёт возможность и интерес изучать тему дальше, а не проходить мимо заголовков про внедрение AI. Я не программист, а архитектор. Но я могу формулировать задачи, понимать контекст отрасли и собирать рабочие прототипы. Кажется, этого уже достаточно, чтобы начать.

Об авторе

Владислав Пономарев

архитектор, Сочи, член правления Союза архитекторов Сочи, лауреат «Зодчества» 2023, победитель Concept Awards 2024, создатель Виртуального музея архитектуры Сочи. Исследую применение AI в строительной отрасли.

Telegram: @vponomarev_ru - GitHub: github.com/vponomarev-tech - Проекты: vponomarev.ru/links - Виртуальный музей: @vmasochi

Источник

Вам также может быть интересно

Криптообвал сегодня: стоит ли покупать Bitcoin на просадке на фоне ударов США и Израиля по Ирану?

Нейропокалипсис отменяется. Почему угроза со стороны ИИ это коллективная иллюзия?