Amazon maakt gebruik van Cerebras wafer-scale chips om AI-modellen op AWS te versnellen

Amazon Web Services kondigde vrijdag aan dat het processors van Cerebras in zijn datacenters zal plaatsen onder een meerjarig partnerschap gericht op AI-inferentie.

De deal geeft Amazon een nieuwe manier om te versnellen hoe AI-modellen prompts beantwoorden, code schrijven en live gebruikersverzoeken verwerken. AWS zei dat het Cerebras-technologie zal gebruiken, inclusief de Wafer-Scale Engine, voor inferentietaken.

De bedrijven hebben de financiële voorwaarden niet gedeeld. De setup is gepland voor Amazon Bedrock binnen AWS-datacenters, waardoor het partnerschap direct in een van Amazons belangrijkste AI-producten wordt geplaatst.

AWS zei dat het systeem Amazon Trainium-aangedreven servers, Cerebras CS-3-systemen en Amazon's Elastic Fabric Adapter-netwerken zal combineren.

Later dit jaar is AWS ook van plan toonaangevende open-source grote taalmodellen en Amazon Nova aan te bieden op Cerebras-hardware. David Brown, vice president van Compute en ML Services bij AWS, zei dat snelheid nog steeds een groot probleem is bij AI-inferentie, vooral voor realtime codehulp en interactieve apps.

David zei: "Inferentie is waar AI echte waarde levert aan klanten, maar snelheid blijft een kritiek knelpunt voor veeleisende workloads zoals realtime coderingshulp en interactieve applicaties."

Amazon splitst prefill en decode over afzonderlijke chips

AWS zei dat het ontwerp een methode gebruikt die inferentiedisaggregatie wordt genoemd. Dat betekent het splitsen van AI-inferentie in twee delen. Het eerste deel is promptverwerking, ook wel prefill genoemd. Het tweede deel is outputgeneratie, ook wel decode genoemd.

AWS zei dat de twee taken zich heel anders gedragen. Prefill is parallel, rekenintensief en heeft gematigde geheugenbandbreedte nodig. Decode is serieel, minder rekenintensief en veel meer afhankelijk van geheugenbandbreedte. Decode kost ook het meeste tijd in deze gevallen omdat elk outputtoken een voor een moet worden geproduceerd.

Daarom wijst AWS verschillende hardware toe aan elke fase. Trainium zal prefill afhandelen. Cerebras CS-3 zal decode afhandelen.

AWS zei dat EFA-netwerken met lage latentie en hoge bandbreedte beide kanten zullen verbinden zodat het systeem als één service kan werken terwijl elke processor zich op een afzonderlijke taak concentreert.

David zei: "Wat we met Cerebras bouwen lost dat op: door de inferentiewerkbelasting te splitsen over Trainium en CS-3, en ze te verbinden met Amazon's Elastic Fabric Adapter, doet elk systeem waar het het beste in is. Het resultaat zal inferentie zijn die een orde van grootte sneller is en hogere prestaties levert dan wat vandaag beschikbaar is."

AWS zei ook dat de service zal draaien op het AWS Nitro System, de basislaag voor zijn cloudinfrastructuur.

Dat betekent dat Cerebras CS-3-systemen en Trainium-aangedreven instances naar verwachting zullen werken met dezelfde beveiliging, isolatie en consistentie die AWS-klanten al gebruiken.

Amazon duwt Trainium harder door terwijl Nvidia een nieuwe bedreiging onder ogen ziet

De aankondiging geeft Amazon ook een nieuwe opening om Trainium te promoten tegen chips van Nvidia, AMD en andere grote chipbedrijven. AWS beschrijft Trainium als zijn interne AI-chip gebouwd voor schaalbare prestaties en kostenefficiëntie bij training en inferentie.

AWS zei dat twee grote AI-labs er al aan zijn toegewijd. Anthropic heeft AWS tot zijn primaire trainingspartner benoemd en gebruikt Trainium om modellen te trainen en te implementeren. OpenAI zal 2 gigawatt aan Trainium-capaciteit verbruiken via AWS-infrastructuur voor Stateful Runtime Environment, frontier-modellen en andere geavanceerde workloads.

AWS voegde toe dat Trainium3 sterke adoptie heeft gezien sinds de recente release, waarbij klanten in verschillende sectoren grote capaciteit toewijzen.

Cerebras behandelt de decodekant van de setup. AWS zei dat CS-3 toegewijd is aan decoderingsversnelling, wat meer ruimte geeft voor snelle outputtokens. Cerebras zegt dat CS-3 's werelds snelste AI-inferentiesysteem is en duizenden keren grotere geheugenbandbreedte levert dan de snelste GPU.

Het bedrijf zei dat redeneermodellen nu een groter aandeel van het inferentiewerk uitmaken en meer tokens per verzoek genereren terwijl ze problemen doorwerken. Cerebras zei ook dat OpenAI, Cognition, Mistral en anderen zijn systemen gebruiken voor veeleisende workloads, vooral agentische codering.

Andrew Feldman, oprichter en chief executive van Cerebras Systems, zei: "Samenwerken met AWS om een gedisaggregeerde inferentieoplossing te bouwen, zal de snelste inferentie naar een wereldwijd klantenbestand brengen."

Andrew voegde toe: "Elke onderneming over de hele wereld zal kunnen profiteren van razendsnelle inferentie binnen hun bestaande AWS-omgeving."

De deal voegt meer druk toe op Nvidia, dat in december een licentieovereenkomst van $20 miljard met Groq ondertekende en volgende week van plan is een nieuw inferentiesysteem met Groq-technologie te onthullen.

Als je dit leest, ben je al voorop. Blijf daar met onze nieuwsbrief.

Misschien vind je dit ook leuk

De Solana Prijsstijging – Het Pleidooi van G Coin voor Infrastructureel Nut

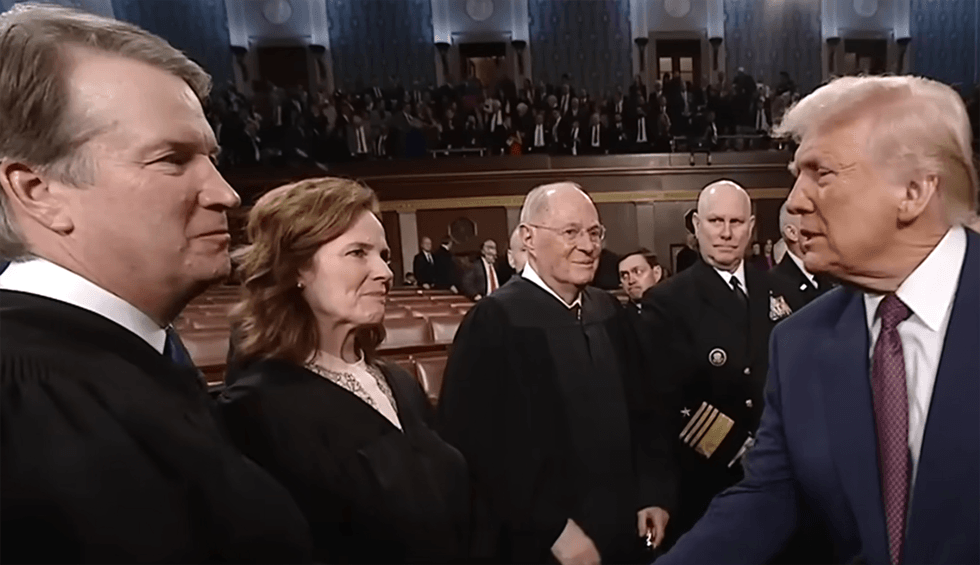

Waarom Trumps overvloed aan lof voor Kavanaugh 'eigenlijk gênant' is: analyse