Síntesis de Datos de Matting Humano Multi-Instancia con MaskRCNN y BG20K

Tabla de Enlaces

Resumen y 1. Introducción

-

Trabajos Relacionados

-

MaGGIe

3.1. Matting de Instancia Guiado por Máscara Eficiente

3.2. Consistencia Temporal Feature-Matte

-

Conjuntos de Datos de Matting de Instancia

4.1. Matting de Instancia de Imagen y 4.2. Matting de Instancia de Vídeo

-

Experimentos

5.1. Pre-entrenamiento en datos de imagen

5.2. Entrenamiento en datos de vídeo

-

Discusión y Referencias

\ Material Suplementario

-

Detalles de arquitectura

-

Matting de imagen

8.1. Generación y preparación del conjunto de datos

8.2. Detalles de entrenamiento

8.3. Detalles cuantitativos

8.4. Más resultados cualitativos en imágenes naturales

-

Matting de vídeo

9.1. Generación del conjunto de datos

9.2. Detalles de entrenamiento

9.3. Detalles cuantitativos

9.4. Más resultados cualitativos

8. Matting de imagen

Esta sección amplía el proceso de matting de imagen, proporcionando información adicional sobre la generación de conjuntos de datos y comparaciones exhaustivas con métodos existentes. Profundizamos en la creación de los conjuntos de datos I-HIM50K y M-HIM2K, ofrecemos análisis cuantitativos detallados y presentamos más resultados cualitativos para subrayar la efectividad de nuestro enfoque.

8.1. Generación y preparación del conjunto de datos

El conjunto de datos I-HIM50K fue sintetizado a partir del conjunto de datos HHM50K [50], que es conocido por su extensa colección de mattes de imágenes humanas. Empleamos un modelo MaskRCNN [14] Resnet-50 FPN 3x, entrenado en el conjunto de datos COCO, para filtrar imágenes de una sola persona, resultando en un subconjunto de 35.053 imágenes. Siguiendo la metodología InstMatt [49], estas imágenes fueron compuestas contra fondos diversos del conjunto de datos BG20K [29], creando escenarios de múltiples instancias con 2-5 sujetos por imagen. Los sujetos fueron redimensionados y posicionados para mantener una escala realista y evitar superposición excesiva, como lo indica que los IoUs de instancia no excedan el 30%. Este proceso produjo 49.737 imágenes, con un promedio de 2,28 instancias por imagen. Durante el entrenamiento, las máscaras de guía fueron generadas mediante la binarización de los mattes alfa y la aplicación de operaciones aleatorias de dropout, dilatación y erosión. Las imágenes de muestra de I-HIM50K se muestran en la Fig. 10.

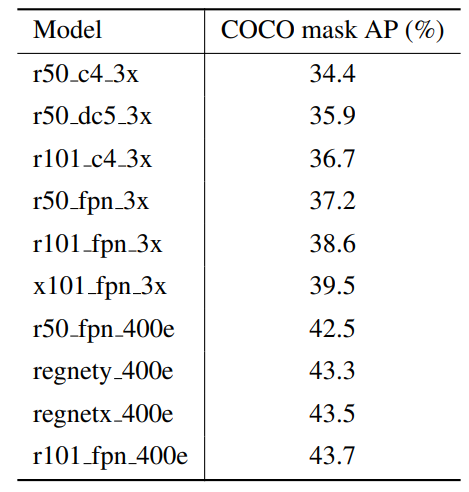

\ El conjunto de datos M-HIM2K fue diseñado para probar la robustez del modelo contra calidades de máscara variables. Comprende diez máscaras por instancia, generadas usando varios modelos MaskRCNN. Más información sobre los modelos utilizados para este proceso de generación se muestra en la Tabla 8. Las máscaras fueron emparejadas con instancias basándose en el IoU más alto con los mattes alfa de referencia, asegurando un umbral mínimo de IoU del 70%. Las máscaras que no cumplieron este umbral fueron generadas artificialmente a partir de la referencia. Este proceso resultó en un conjunto completo de 134.240 máscaras, con 117.660 para imágenes compuestas y 16.600 para imágenes naturales, proporcionando un punto de referencia robusto para evaluar el matting de instancia guiado por máscara. El conjunto de datos completo I-HIM50K y M-HIM2K será publicado después de la aceptación de este trabajo.

\

\

\

:::info Autores:

(1) Chuong Huynh, University of Maryland, College Park (chuonghm@cs.umd.edu);

(2) Seoung Wug Oh, Adobe Research (seoh,jolee@adobe.com);

(3) Abhinav Shrivastava, University of Maryland, College Park (abhinav@cs.umd.edu);

(4) Joon-Young Lee, Adobe Research (jolee@adobe.com).

:::

:::info Este artículo está disponible en arxiv bajo licencia CC by 4.0 Deed (Atribución 4.0 Internacional).

:::

\

También te puede interesar

La Unión Europea envió una carta a Lula en la que se comprometió a firmar el acuerdo comercial con el Mercosur en enero

TechCabal presenta la Lista de Constructores: El índice definitivo de los constructores que dan forma al futuro de África